Was ist ein Vision-Sensor? - Blockbasiert

![]() Lehrer-Toolbox

-

Der Zweck dieser Seite

Lehrer-Toolbox

-

Der Zweck dieser Seite

Auf dieser Seite werden die Schüler vorgestellt, was ein Vision-Sensor ist und welche Funktionen er bietet. Die Studierenden analysieren dann ein Teilbild eines Beispielprojekts, um zu sehen, wie der Vision Sensor mit VEXcode V5 verwendet werden kann.

Die Fragen zur Motivationsdiskussion am Ende der Seite können als Klassendiskussion oder einzeln in den technischen Notizbüchern der Schüler ausgefüllt werden.

Beschreibung

Der Vision Sensor ermöglicht es Ihrem Roboter, visuelle Daten aus einem Live-Feed zu sammeln. Ein Live-Feed ist eine Streaming-Übertragung dessen, was eine Videokamera aufnimmt. Der Vision Sensor ist wie eine intelligente Kamera, die Farben und Objekte, die in ihrem Sichtfeld erscheinen, beobachten, auswählen, einstellen und speichern kann.

Fähigkeiten:

- Dieser Sensor kann zur Erkennung von Farben und Farbmustern verwendet werden.

- Dieser Sensor kann verwendet werden, um einem Objekt zu folgen.

- Dieser Sensor kann verwendet werden, um Informationen über die Umgebung zu sammeln.

Der Vision Sensor ermöglicht es dem Roboter, visuelle Eingabedaten aus seiner Umgebung zu verwenden. Das Projekt kann dann bestimmen, wie sich die visuellen Eingabedaten auf das Verhalten des Roboters auswirken sollen. Beispielsweise könnte der Roboter Aktionen (Output) wie Spinnmotoren oder die Anzeige von Ergebnissen auf dem LCD-Bildschirm ausführen.

Der Vision Sensor kann auch einen Schnappschuss dessen erfassen, was sich vor ihm befindet, und ihn entsprechend der Frage des Benutzers analysieren. Beispielsweise kann ein Benutzer Daten aus dem Snapshot sammeln, z. B. welche Farbe hat das Objekt? Wird überhaupt ein Objekt erkannt? Wie groß ist das Objekt (Breite und Höhe)?

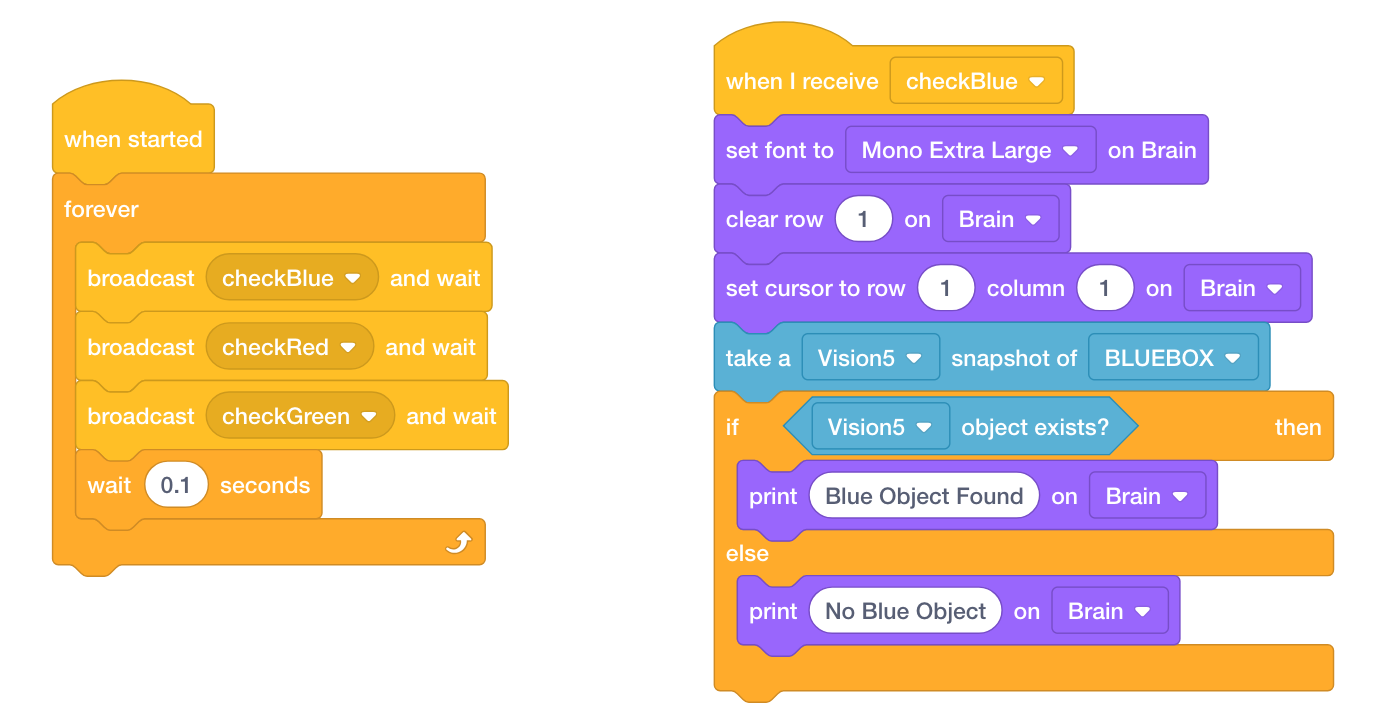

Der Roboter kann dann basierend auf diesen Daten Entscheidungen treffen. Das folgende Teilbeispielprojekt zeigt, wie dies geschieht. Drei Farben werden wiederholt überprüft, nachdem das Projekt gestartet wurde, und jede Farbprüfung ist ein anderes Ereignis. Nachfolgend wird nur das Ereignis angezeigt, das nach Blau sucht. Dieser Stapel hat den Roboterdruck „Blaues Objekt gefunden“, wenn ein blaues Objekt erkannt wird oder sonst „Kein blaues Objekt“. Die unten nicht gezeigten checkRed- und checkGreen-Ereignisse haben ähnliche Stapel, um zu entscheiden, was auf dem Bildschirm gedruckt werden soll.

![]() Diskussion motivieren

Diskussion motivieren

F: Welche Arten von menschlichen Jobs würden von der Hilfe eines Roboters mit einem Vision-Sensor profitieren?

A: Achten Sie auf menschliche Jobs, die von der Fähigkeit profitieren würden, in Umgebungen zu sehen und/oder die Umgebung aus der Ferne zu manipulieren (z. B. Tiere in freier Wildbahn zu beobachten, Sprengstoffe zu entwaffnen oder robotergestützte Operationen durchzuführen).

F: Benennen Sie ein Gerät und beschreiben Sie, wie es Eingabe, Ausgabe und Prozess verwendet.

A: Eine mögliche Antwort könnte ein Rechner sein, der die Zahlenfolgen und mathematischen Operatoren einer Person eingibt, diese Zahlen und Operationen verarbeitet, um ein Ergebnis zu berechnen, und dann die Ergebnisse auf einem Bildschirm für die Person ausgibt.

F: Warum wurde in dem oben gezeigten Projekt Ihrer Meinung nach eine Endlosschleife verwendet?

A: Es wurde eine Endlosschleife verwendet, damit der Vision-Sensor die mehreren aufgenommenen Schnappschüsse kontinuierlich überprüft, um festzustellen, ob ein rotes Objekt in Sichtweite des Sensors kommt.